AI最前線:面向人群計(jì)數(shù)場(chǎng)景的感知對(duì)抗補(bǔ)丁

責(zé)編:gltian |2022-10-08 14:47:59

近年來,人工智能的飛速發(fā)展也引發(fā)了人們對(duì)該領(lǐng)域安全性的廣泛關(guān)注,在許多領(lǐng)域,人工智能產(chǎn)品安全將直接關(guān)乎人類社會(huì)公共安全。最近,來自北京航空航天大學(xué)、約翰霍普金斯大學(xué)等機(jī)構(gòu)的研究人員發(fā)現(xiàn),用于監(jiān)控人流密度的AI自動(dòng)人群計(jì)數(shù)系統(tǒng)同樣存在安全隱患。

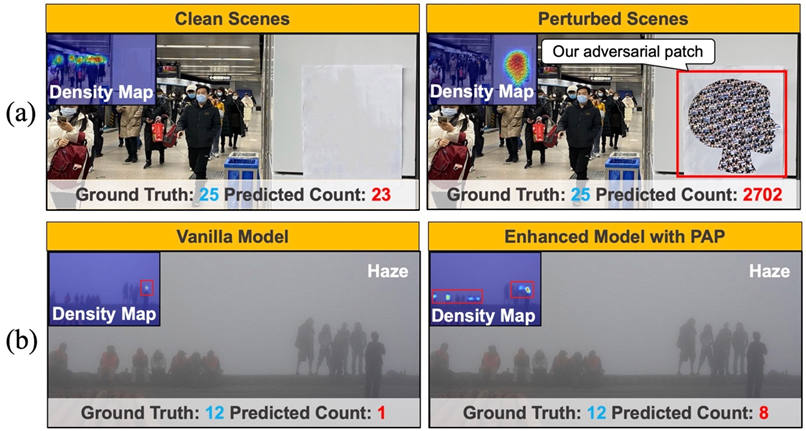

研究者們提出了一種基于模型感知特性的對(duì)抗補(bǔ)丁生成框架(PAP),生成微小的對(duì)抗貼紙便可輕松導(dǎo)致基于密度圖估計(jì)的人群計(jì)數(shù)模型(下文簡(jiǎn)稱人群計(jì)數(shù)模型)識(shí)別崩潰(下圖(a))。數(shù)字世界和真實(shí)世界的大量實(shí)驗(yàn)證明了這種對(duì)抗補(bǔ)丁的強(qiáng)攻擊性。進(jìn)一步,研究者利用設(shè)計(jì)的感知對(duì)抗補(bǔ)丁進(jìn)行對(duì)抗訓(xùn)練,發(fā)現(xiàn)可以一定程度提升模型在原任務(wù)場(chǎng)景下對(duì)未知人群尺度的泛化能力和對(duì)復(fù)雜背景的魯棒性(下圖(b))。

尺度感知特性&位置感知特性

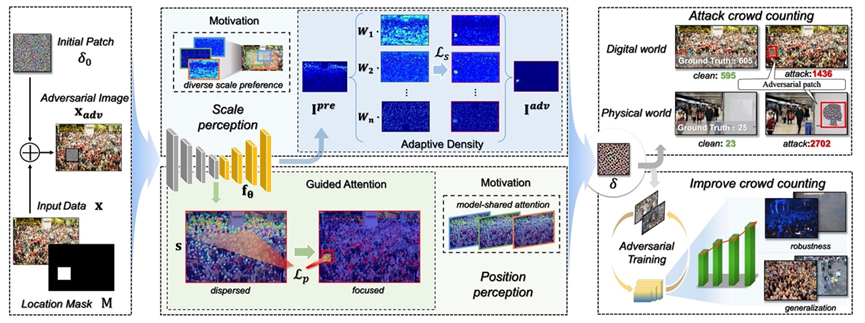

對(duì)于真實(shí)場(chǎng)景,由于我們事先無(wú)法知曉被攻擊系統(tǒng)的模型信息,并且考慮到訪問權(quán)限等問題,論文采用了基于對(duì)抗樣本遷移的黑盒攻擊方法。因此,對(duì)抗補(bǔ)丁的黑盒遷移能力決定了其在真實(shí)世界中應(yīng)用的攻擊能力。與先前的研究工作不同,論文從人群計(jì)數(shù)模型的特有感知屬性角度,設(shè)計(jì)提升對(duì)抗補(bǔ)丁攻擊遷移性的策略。論文觀察到了人群計(jì)數(shù)模型的兩個(gè)潛在感知特性,即尺度感知與位置感知,如下圖所示。

對(duì)于尺度感知,人群計(jì)數(shù)模型往往采用不同的分支結(jié)構(gòu)來捕獲不同程度的人群尺度特征。圖中展示了MCNN模型的3個(gè)不同分支捕獲的特征圖和6種常見人群計(jì)數(shù)模型的預(yù)測(cè)密度圖,可以看到,不同結(jié)構(gòu)的模型因感受野等差異導(dǎo)致存在一定程度的尺度偏好。常規(guī)的優(yōu)化方法將容易導(dǎo)致對(duì)抗補(bǔ)丁擬合到特定的尺度信息上,從而降低其泛化能力。因此,論文提出基于密度權(quán)重的自適應(yīng)尺度感知模塊,通過動(dòng)態(tài)調(diào)節(jié)補(bǔ)丁優(yōu)化過程中不同尺度的比重來增強(qiáng)對(duì)抗補(bǔ)丁的尺度感知不變性。

對(duì)于位置感知,通過基于人群密度的Grad-Cam方法,論文發(fā)現(xiàn)不同的人群計(jì)數(shù)模型擁有相似的注意力模式。在識(shí)別人群的過程中,模型注意力總是呈分散狀落在人頭區(qū)域。基于此,論文通過將模型共享的注意力區(qū)域匯聚到補(bǔ)丁所在位置,從而使對(duì)抗補(bǔ)丁在優(yōu)化中捕獲位置感知不變特征,進(jìn)一步增強(qiáng)其攻擊遷移能力。

感知對(duì)抗補(bǔ)丁生成框架

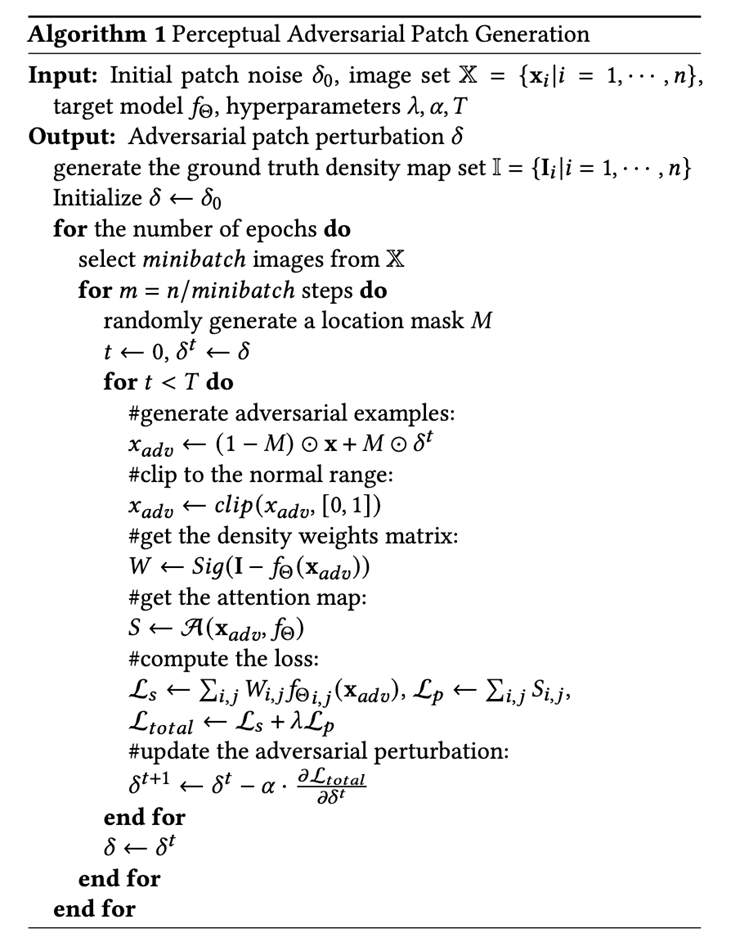

基于人群計(jì)數(shù)模型的尺度和位置感知特性,論文提出了一種感知對(duì)抗補(bǔ)丁生成框架,如下圖所示。在基本的對(duì)抗補(bǔ)丁優(yōu)化框架中,引入基于自適應(yīng)密度權(quán)重的尺度感知模塊和基于導(dǎo)向注意力的位置感知模塊,用于提升對(duì)抗樣本的黑盒遷移能力。生成的對(duì)抗補(bǔ)丁既可以實(shí)現(xiàn)高強(qiáng)度攻擊,又可以被用來作為增強(qiáng)數(shù)據(jù)提升模型的泛化性和魯棒性。下面分別介紹兩個(gè)感知模塊的設(shè)計(jì)方案。

基于自適應(yīng)密度的尺度感知

人群計(jì)數(shù)領(lǐng)域的研究指出,對(duì)于視野中不同尺度的人群感知是目前的難點(diǎn)之一。已有的深度學(xué)習(xí)模型對(duì)于多尺度特征的捕獲是不完備的,不同的人群計(jì)數(shù)模型在密度預(yù)測(cè)結(jié)果中呈現(xiàn)出一定程度的尺度偏好。因此,高遷移性要求對(duì)抗補(bǔ)丁在多種尺度特征下均具有攻擊能力。為達(dá)成這一目標(biāo),論文引入了自適應(yīng)密度權(quán)重機(jī)制。

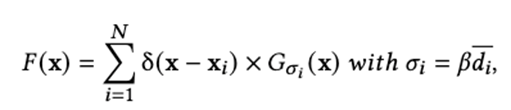

首先,參考人群計(jì)數(shù)工作的一般處理方式,對(duì)于輸入的圖像x,我們通過幾何自適應(yīng)的高斯核對(duì)其進(jìn)行處理來獲得密度圖的真值I。

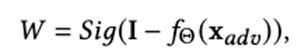

通過使用高斯核平滑每個(gè)人的頭部標(biāo)注信息,真值密度圖I考慮了輸入圖像的空間分布,因此可認(rèn)為其包含場(chǎng)景的全部人群尺度信息。基于此,論文提出密度權(quán)重矩陣W如下。

對(duì)于每次迭代,可以通過比較真實(shí)值和預(yù)測(cè)值來更新W。顯然,對(duì)于某一尺度的人群區(qū)域,其在真值密度圖當(dāng)中會(huì)呈現(xiàn)出高值,而模型若沒有感知到該人群區(qū)域,即預(yù)測(cè)密度圖中該區(qū)域沒有高值,則該區(qū)域?qū)⒈毁x予更大的權(quán)重。換句話說,通過權(quán)重W可以強(qiáng)化源模型中感知薄弱的特征,這將有助于補(bǔ)丁更好地捕獲它們。之后,將權(quán)重乘到預(yù)測(cè)密度圖當(dāng)中并逐像素點(diǎn)累加得到賦權(quán)的預(yù)測(cè)人群數(shù)作為尺度感知損失。

通過優(yōu)化該損失,對(duì)抗補(bǔ)丁可以更好捕獲尺度不變特征從而更好適應(yīng)不同模型的尺度感知偏好,進(jìn)而提升攻擊遷移性。

基于導(dǎo)向注意力的位置感知

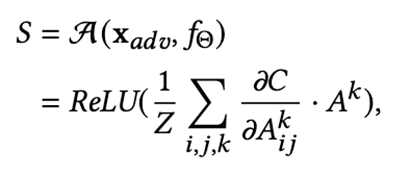

Grad-Cam作為模型可解釋的方法之一,可以有效歸納模型決策的依據(jù)。受其啟發(fā),論文設(shè)計(jì)了密度引導(dǎo)的模型注意力提取方法,以幫助對(duì)抗補(bǔ)丁捕獲位置不變特征并干擾位置感知。具體來講,對(duì)于輸入x,可以通過以下模塊提取注意力圖S,其中C表示預(yù)測(cè)人群數(shù)。

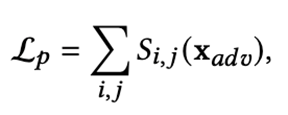

為了成功攻擊人群計(jì)數(shù)模型,論文將模型的注意力吸引到對(duì)抗補(bǔ)丁上,從而分散它對(duì)于人群的注意力。論文引入如下的位置感知損失,其為注意力圖的像素值加和。

因此,具有相似關(guān)注區(qū)域的不同模型將聚焦于對(duì)抗補(bǔ)丁,并做出錯(cuò)誤的預(yù)測(cè)。

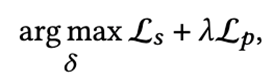

綜上所述,整體優(yōu)化目標(biāo)為聯(lián)合優(yōu)化尺度與位置感知損失。論文考慮了正向攻擊(預(yù)測(cè)人群數(shù)增多)與負(fù)向攻擊(預(yù)測(cè)人群數(shù)減少)兩種形式。對(duì)于前者,優(yōu)化目標(biāo)為聯(lián)合損失最大,如下式,

對(duì)于負(fù)向攻擊,僅需最小化聯(lián)合損失即可。

整體算法框架的訓(xùn)練流程如下圖:

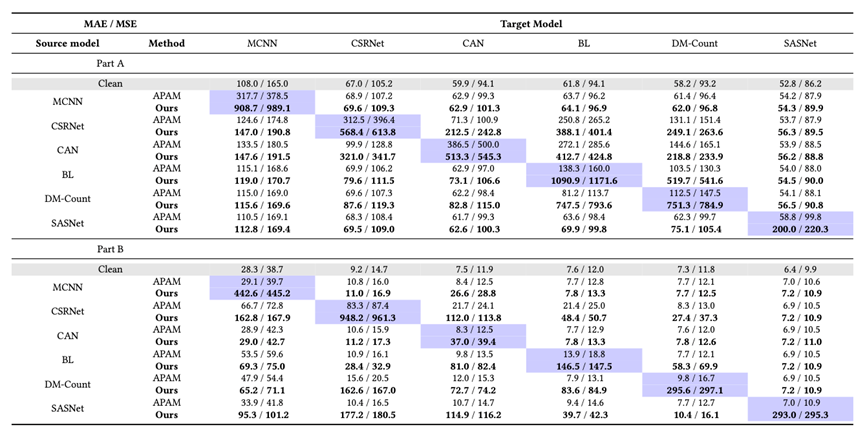

數(shù)字世界攻擊實(shí)驗(yàn)

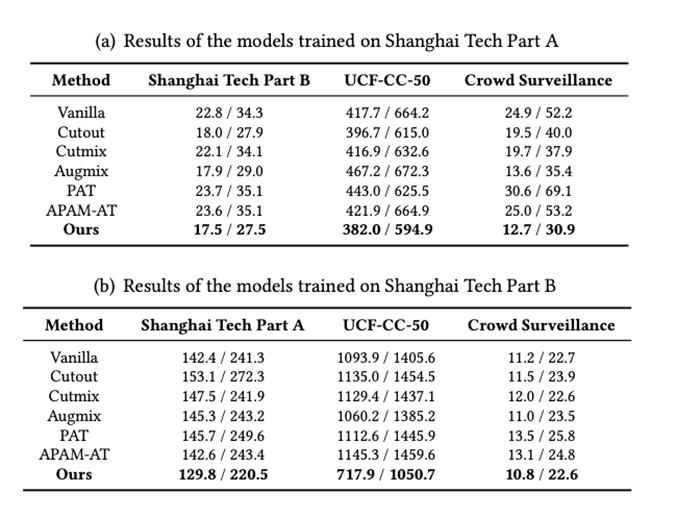

論文在Shanghai Tech數(shù)據(jù)集上進(jìn)行了數(shù)字世界攻擊實(shí)驗(yàn)。數(shù)據(jù)集分為Part A與Part B兩部分,兩者由于采集環(huán)境的不同呈現(xiàn)不同的分布。論文選用了6個(gè)常用人群計(jì)數(shù)模型,并采用平均絕對(duì)誤差與平均平方誤差作為衡量指標(biāo)。首先,論文與之前的人群計(jì)數(shù)對(duì)抗攻擊算法APAM進(jìn)行了比較,結(jié)果如下所示。

實(shí)驗(yàn)證明論文提出的方法無(wú)論是白盒還是黑盒表現(xiàn)均優(yōu)于對(duì)比算法。

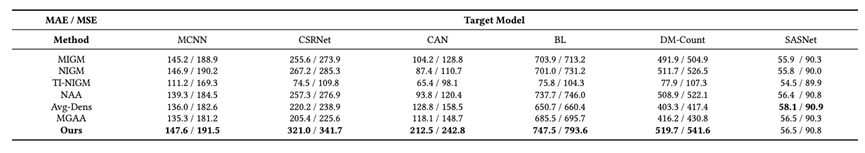

除此之外,論文還與其他遷移攻擊算法進(jìn)行了比較。如下所示,實(shí)驗(yàn)證明除在SASNet上的表現(xiàn)稍差于集成攻擊方法外,PAP攻擊效果均超過其他算法。

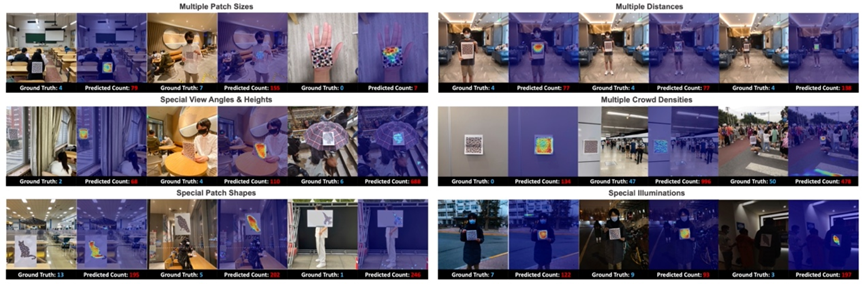

物理世界攻擊實(shí)驗(yàn)

在物理世界實(shí)驗(yàn)中,論文考慮了補(bǔ)丁尺寸、距離、角度、形狀、光照等多種真實(shí)世界條件變化的影響。多種場(chǎng)景下共采集110張實(shí)驗(yàn)圖像用于黑盒驗(yàn)證,實(shí)驗(yàn)結(jié)果如下圖所示。

可以看到,生成的對(duì)抗補(bǔ)丁在真實(shí)環(huán)境下仍然具有很高的攻擊性。

除此之外,論文中對(duì)于兩種感知損失進(jìn)行了消融驗(yàn)證,并探討了超參、補(bǔ)丁形狀、數(shù)據(jù)集、對(duì)抗防御策略等對(duì)于算法性能的影響,分析了負(fù)向攻擊效應(yīng),感興趣的朋友可以查看原論文。

對(duì)抗訓(xùn)練提升原任務(wù)性能

研究者認(rèn)為,對(duì)抗樣本除具備強(qiáng)大的攻擊能力以外,還可作為特殊的增強(qiáng)數(shù)據(jù)用于提升原任務(wù)的表現(xiàn)。基于此,論文采用了標(biāo)準(zhǔn)的對(duì)抗訓(xùn)練框架,如下式。

由于感知對(duì)抗補(bǔ)丁可以攻擊不同人群尺度感知下的模型,并干擾它們聚焦于錯(cuò)誤的位置感知區(qū)域。因此,使用對(duì)抗補(bǔ)丁進(jìn)行對(duì)抗訓(xùn)練,可以進(jìn)一步增強(qiáng)模型對(duì)尺度和位置擾動(dòng)的容忍度。換言之,使用感知對(duì)抗補(bǔ)丁增強(qiáng)的人群計(jì)數(shù)模型可以提升對(duì)多人群尺度的感知泛化,并通過更好地關(guān)注噪音下的人群本身來糾正位置感知偏差。因此,它將更好地應(yīng)用到具有未知人群尺度的場(chǎng)景,并更加關(guān)注人群區(qū)域,而不是自然場(chǎng)景中的復(fù)雜環(huán)境背景。

論文與數(shù)據(jù)增強(qiáng)以及不同擾動(dòng)形式的對(duì)抗訓(xùn)練方法進(jìn)行了實(shí)驗(yàn)比較。泛化性實(shí)驗(yàn)結(jié)果如下,可以看到論文提出的感知對(duì)抗補(bǔ)丁訓(xùn)練方法可以有效提升模型跨數(shù)據(jù)集的泛化能力。

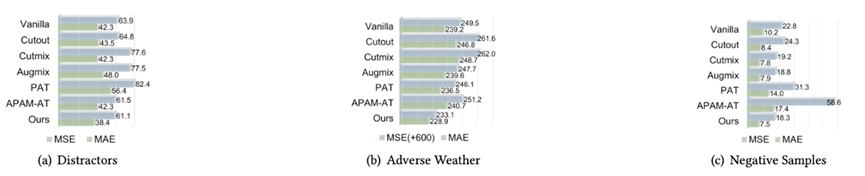

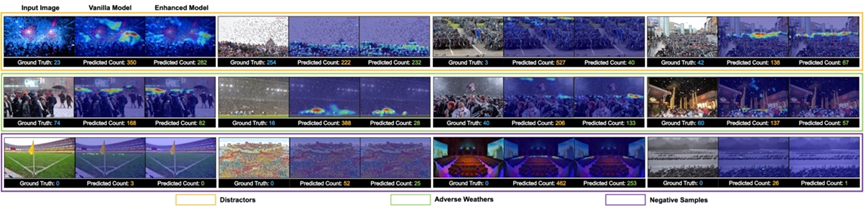

論文在具有類人群干擾物的樣本、惡劣天氣樣本以及無(wú)人群負(fù)樣本上驗(yàn)證了模型對(duì)復(fù)雜背景的魯棒性。實(shí)驗(yàn)結(jié)果如下:

可以看到,原始模型的密度圖上突出顯示了許多非目標(biāo)區(qū)域,而增強(qiáng)模型對(duì)這些干擾因素更為魯棒。使用PAP訓(xùn)練的模型可以更準(zhǔn)確地關(guān)注人類區(qū)域,因此增強(qiáng)模型預(yù)測(cè)的人數(shù)更接近實(shí)際情況。

總結(jié)與展望

對(duì)抗攻擊作為一種發(fā)現(xiàn)AI安全漏洞的有效方法,迫使研究人員更加關(guān)注模型的魯棒性。本文提出感知對(duì)抗補(bǔ)丁生成框架(PAP),利用模型尺度感知和位置感知來學(xué)習(xí)模型不變特征,從而提升對(duì)抗補(bǔ)丁的攻擊遷移性。數(shù)字和物理世界大量實(shí)驗(yàn)表明PAP達(dá)到了最先進(jìn)的性能。通過攻擊,研究者發(fā)現(xiàn)在回歸任務(wù)上現(xiàn)有的對(duì)抗防御策略并非無(wú)懈可擊。此外,值得進(jìn)一步探討如何有效地定義人群計(jì)數(shù)這類回歸任務(wù)的魯棒性性度量指標(biāo)。

此外,這種攻擊策略可以起到隱私保護(hù)的作用。通過破壞惡意監(jiān)視系統(tǒng)來保護(hù)人群信息,從而防止公眾合法集會(huì)的權(quán)利被侵犯。在這種場(chǎng)景下,仍有許多障礙需要克服,例如如何使對(duì)抗補(bǔ)丁看起來足夠自然,如何有效地覆蓋所有被觀測(cè)區(qū)域等。盡管本工作建議在衣服或海報(bào)上印貼補(bǔ)丁,但研究者期望更有效的補(bǔ)丁生成方法來防止人類感知帶來的異常警告。

從另一個(gè)角度來看,我們期望自動(dòng)人群計(jì)數(shù)模型具有強(qiáng)大的通用性,以應(yīng)對(duì)不斷變化的真實(shí)狀況。然而,現(xiàn)有的深度學(xué)習(xí)方法存在過擬合已知數(shù)據(jù)分布的問題。與大多數(shù)之前的研究相比,論文驚奇地發(fā)現(xiàn),使用對(duì)抗補(bǔ)丁進(jìn)行對(duì)抗性訓(xùn)練可以提升模型原任務(wù)的泛化性能,揭示了對(duì)抗攻擊技術(shù)向善的一種可能。雖然論文中提供了初步的解釋,但研究者認(rèn)為該性質(zhì)和機(jī)制值得未來進(jìn)一步研究。

論文信息

該論文已被全球安全領(lǐng)域頂級(jí)會(huì)議 ACM Conference on Computer and Communications Security (ACM CCS) 2022接收。

Shunchang Liu, Jiakai Wang, Aishan Liu, Yingwei Li, Yijie Gao, Xianglong Liu, Dacheng Tao. Harnessing Perceptual Adversarial Patches for Crowd Counting. ACM CCS, 2022.

代碼鏈接:https://github.com/shunchang-liu/PAP-Pytorch

撰稿:劉艾杉,北京航空航天大學(xué)計(jì)算機(jī)學(xué)院助理教授

郵箱:liuaishan@buaa.edu.cn

個(gè)人主頁(yè):http://scse.buaa.edu.cn/info/1080/8731.htm

來源:隱者聯(lián)盟

- 國(guó)家互聯(lián)網(wǎng)信息辦公室發(fā)布《國(guó)家信息化發(fā)展報(bào)告(2024年)》

- 火狐中國(guó)終止運(yùn)營(yíng):辦公地?zé)o人,用戶賬號(hào)數(shù)據(jù)面臨清空

- 25年一直未變!網(wǎng)絡(luò)安全永恒的“十大法則”

- 關(guān)于征集數(shù)據(jù)安全評(píng)估標(biāo)準(zhǔn)化應(yīng)用實(shí)踐案例的通知

- ISC.AI 2025主題前瞻:ALL IN AGENT,全面擁抱智能體時(shí)代!

- 美國(guó)網(wǎng)絡(luò)司令部繼續(xù)投資開發(fā)網(wǎng)攻發(fā)起平臺(tái)JCAP

- 關(guān)稅大棒下的地緣政治博弈:APT組織瞄準(zhǔn)中非命運(yùn)共同體

- 權(quán)威認(rèn)證!Fortinet再奪Gartner SASE平臺(tái)魔力象限領(lǐng)導(dǎo)者

- 供應(yīng)商失職致嚴(yán)重網(wǎng)絡(luò)攻擊,客戶起訴索賠27億元

- 《移動(dòng)互聯(lián)網(wǎng)應(yīng)用程序(APP)風(fēng)險(xiǎn)分類分級(jí)指南2025年》筑起網(wǎng)絡(luò)安全防線